Google supprime les autocomplétions pour « les africains sont »

Il y’a quelques jours j’écrivais cet article sur les suggestions automatiques de Google .

Plusieurs jours après avoir publié l’article et contacté Google au sujet des autocomplétions (les propositions automatiques des moteurs de recherche), sur les termes « les africains sont », les recherches les concernant retournaient toujours des suggestions offensantes.

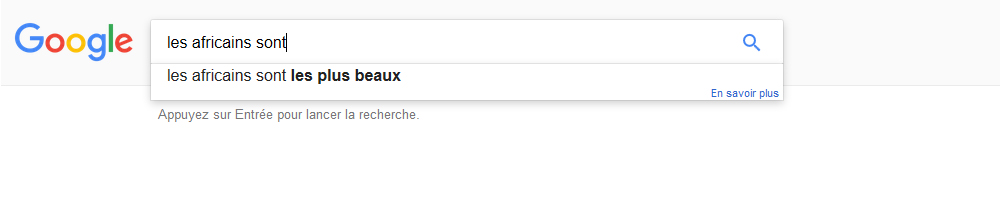

Mais Google a finalement décidé de supprimer toutes les suggestions sur ces termes en guise de cadeau de nouvel an. Désormais, lorsque vous tapez « les africains sont » il vous retourne une réponse qui ressemble à la limite à de la drague… 😀

Pourquoi Google supprime certaines suggestions et pas d’autres ?

Dans le mail que j’ai adressé à Google, je voulais voir les suggestions de recherches pour deux (2) requêtes annulées. La première a eu gain de cause mais, visiblement, la seconde n’a pas été traitée. En effet lorsque vous tapez : « les noirs», vous avez tout de suite des autocomplétions pas très sympas qui s’affichent.

Cependant, lorsque vous prenez la peine de consulter les contenus, vous vous rendez compte que les articles sérieux qui en parlent n’ont de méchant que les titres. Par exemple la première suggestion renvoie vers un article qu’a écrit une femme noire racontant ses déboires au travail. Les contenus les plus offensants se trouvent dans les forums. Celui-ci par exemple est un forum de gamers s’affrontant à coup d’injures les uns des autres à propos d’une odeur particulière qu’aurait les noirs. La difficulté avec les forums est que les intervenants sont la plupart du temps couvert d’anonymat, donc difficile à gérer.

Personnellement, je crois que Google retire des suggestions lorsqu’elles renvoient dès les tout premiers résultats vers des discours haineux ou des contenus pornographiques. Mais aussi lorsque l’auteur ne se cache pas derrière un pseudonyme et qu’en plus le site dispose d’une certaine fréquence de visite. C’est ce qui explique qu’une suggestion peut être supprimer dans une langue mais pas dans d’autres, car la nature des contenus n’est pas la même.

Pour tenter de gérer ce casse-tête, Google fait appel à une armée de modérateurs de par le monde. En 2015, 2 millions de billets étaient publiés sur internet par les blogueurs et autres acteurs du web chaque jour. Ces modérateurs ne pourront jamais, à eux seuls, scruter cette énorme masse d’information et prendre des décisions effectives.

Évidemment, pour une telle tâche, le recours aux algorithmes est privilégié. Mais quoi que l’on dise, ces programmes informatiques sont pour le moment incapables de comprendre et d’interpréter des phénomènes sociaux ou comportementaux, par nature, impossible à quantifier. L’exemple des critères d’affinité utilisés par les sites de rencontre et les réseaux sociaux en est la preuve.

Pourquoi les explications de Google sont toujours généralistes?

Faute de trouver une explication compréhensible par le grand public, Google se cache souvent derrière la rigueur mathématique de ses algorithmes. Comme si cette complexité pouvait servir d’excuses et justifier de tels manquements.

Impressionné par les discours rigoureux ; c’est en croisant les bras, bouche ouverte, les yeux brillants de fascination que nous assimilons la précision à l’exactitude lorsque la firme de Mountain View dit la messe.

En général, Google explique des centaines de milliers, voire de millions, de lignes de code en quelques mots, ou par un simple tweet.

Mais bon, même s’il expliquait de A à Z comment fonctionne sa technologie, seuls les érudits du domaine comprendraient quelque chose 😉

Je pense que Google n’explique pas en claire les processus conduisant aux suggestions pour des raisons de confidentialité. Car bien de petits malins tripoteurs de programmes n’attendent que cela. Essayer de comprendre comment ça marche, pour s’engouffrer dans la moindre brèche et faire des dégâts.

En 2015 par exemple, lancer une recherche avec les termes « nigger house » (maison du nègre) et « nigger king » (le roi nègre) retournait des résultats vers la Maison Blanche sur Google Map. Google n’a jamais fourni aucune explication officielle, mais s’est simplement excusé. C’est dire combien il tient à rester muet sur sa technologie, comme une mère tigresse qui ne cède devant rien pour disculper son enfant pourtant instable.

Pour résumer, je crois que Google devrait peut-être encourager ses utilisateurs à signaler des abus, et surtout veiller à ce que les abus notifiés soient vraiment traités. Il doit adopter une politique collaborative et inclusive, mais pas exclusive.

Commentaires